Sonocromática

(2008-2009)

[performance]

Grupo Ao Cubo

Textos extraídos de minha dissertação de mestrado:

“’Sonocromática’ é uma performance que trata das relações entre continuidade, evolução e fragmentação por meio de luzes, imagens e sons que são aos poucos revelados e correlacionados. O trabalho faz referência direta a dois momentos da obra de Abraham Palatnik: os ‘Aparelhos Cinecromáticos’, série de obras visuais da década de 1950, construídas com luzes e mecanismos em constante, mas lenta, movimentação; e a série de pinturas intituladas ‘Progressões’, marcadas pelo uso de listras que parecem deslocar a superfície da pintura, ao mesmo tempo que sugerem relações de espelhamento entre os fragmentos da pintura” (Ao_Cubo, 2009).

O ponto de partida para a performance “Sonocromática” foi uma sugestão minha ao grupo: fazer um trabalho performático utilizando pequenas luzes led, com pisca-pisca, muito utilizadas como elemento de entretenimento em festas (ilustração 62). Logo nas primeiras discussões sobre esta possibilidade, decidimos ampliar o conceito para o uso de luzes no trabalho e estabelecer uma relação com algumas obras do artista plástico Abraham Palatnik.

Ilustração 60 – “Sonocromática”, FILE 2008, Teatro do SESI, São Paulo (Foto: Mário Ladeira).

Através de diversas reuniões, o grupo explorou distintas possibilidades para o uso artístico das pequenas luzes. Estudou os trabalhos de Palatnik, principalmente os “Aparelhos Cinecromáticos”, série de trabalhos que envolvia o uso de lâmpadas e mecanismos motorizados, em constante e lento movimento atrás de uma superfície leitosa translúcida. Com estes trabalhos Palatnik criou obras visuais que, ao contrário de quadros estáticos, estavam em constante transformação.

“Quem depara com um aparelho cinecromático é imediatamente enfeitiçado. Os olhos ficam paralisados pelo movimento das luzes e das cores, pelo ritmo luminoso que invade o espaço. É como se uma pintura abstrata repentinamente ficasse animada produzindo efeitos de cor variados e sincronizados. As questões do artista são oriundas da pintura, mas transformadas pelo uso da tecnologia, do motor que dá movimento a um circuito elétrico que vai acendendo um conjunto variado de luzes coloridas. Todo o mecanismo fica escondido sob uma tela e só se vê o efeito da cor-luz movendo-se no espaço. (...). O ritmo do cinecromático é lento e são dezenas de lâmpadas funcionando com base numa combinatória que se repete de acordo com as determinações do artista, podendo chegar até 20 minutos – e recomeçando o processo em looping” (Osorio, 2004. pp. 60-61).

Resolvemos criar uma performance inspirada neste conceito de lentos movimentos em constante transformação. Para fazer uma referência mais direta à obra de Palatnik optamos por empregar uma estrutura no palco que também tivesse uma superfície com aparência translúcida e leitosa. Deste modo, ao utilizar lâmpadas com diferentes cores em seu interior, podíamos criar nesta superfície desenhos de luzes similares aos criados por Palatnik ao mesmo tempo em que omitíamos do público os elementos mecânicos geradores da movimentação.

Ilustração 61 – “Aparelho Cinecromático”, de Abraham Palatnik em funcionamento, à esquerda; e em construção, ao centro (Osorio, 2004. pp. 81 e 85); performer dentro da estrutura de “Sonocromática”, à direita, durante apresentação no FILE RIO 2009 (Foto: Lílian Campesato).

A solução que foi utilizar um pano branco cobrindo a mesma estrutura utilizada na “Teia”, mas montada de forma diferente. Ao invés de formar um cubo de dois metros por dois metros, formava agora um retângulo de um metro de altura e profundidade, e dois metros de largura.

Ilustração 62 – Luzes LED, também utilizadas em “Sonocromática” (Foto: Vitor Kisil)

O fato de a estrutura ter sido feita com peças intercambiáveis de metal de um metro de comprimento possibilitou a criação deste novo formato. A face voltada para o fundo do palco permanecia sem o pano para permitir ao intérprete manipular as luzes de dentro da estrutura.

A estrutura formal básica que definimos, era: em um primeiro momento, explorar estes movimentos lentos e contínuos das luzes feitos pelo performer dentro da estrutura, também refletidos na parte musical da performance. Estas luzes seriam provenientes de lâmpadas incandescentes coloridas, e pequenos refletores. As imagens projetadas no fundo do palco acompanhariam esta movimentação lenta e constante, ampliando o campo visual do público. Depois as lâmpadas seriam lentamente substituídas por uma das pequenas luzes LED com pisca-pisca, que sairia de dentro da estrutura, e começaria sua própria trajetória junto com outras pequenas luzes LED.

Este momento em que a luz sai de dentro da estrutura faz referência à outra série de trabalhos de Palatnik, “Objetos Cinéticos”, no sentido que, ao contrário dos “Aparelhos Cinecromáticos”, os motores e mecanismos ficam expostos e se tornam o centro da atenção do público. Segundo Osorio, ao começar a realizar este tipo de trabalho, Palatnik:

“trará para frente, para fora da tela, o mecanismo motorizado que movimentava os cinecromáticos e iniciará uma série de objetos cinéticos, com pequenas hastes e placas de cor que se mexem lentamente diante do espectador. O fascínio não é mais com a luz, mas apenas com o movimento e ele pode ser tanto real como virtual” (Osorio, 2004. p. 65).

No momento em que o performer sai da estrutura e começa a movimentar as luzes LED, ele, que é o “mecanismo” utilizado na primeira parte, é revelado ao público e inicia uma nova etapa da apresentação[1].

Na ilustração seguinte podemos ver do lado esquerdo um “Objeto Cinético” de Palatnik, que se movia continuamente diante do público, e, do lado direito, um fragmento de “Sonocromática”, onde o performer manipula continuadamente as luzes diante do público.

[1] Vale destacar que os movimentos performáticos deste trecho foram desenvolvidos por Francisco Serpa.

Ilustração 63 – “Objeto Cinético”, 1966, Abraham Palatnik (Osorio, 2004. p. 171); e fragmento de “Sonocromática”, FILE RIO 2009 (Foto: Lílian Campesato)

Conforme foram ocorrendo os ensaios, a estrutura formal da peça foi sendo delimitada. No início da performance, ao contrário de Palatnik, nossas luzes permaneceriam espacialmente estáticas. A movimentação visual seria gerada apenas pela variação de intensidade das mesmas. Depois ganhariam lentos movimentos, e, no decorrer da performance, ganhariam vida própria e sairiam da estrutura.

Os sons acompanhariam e conduziriam, simultaneamente, estes movimentos. Mas, como a matéria prima utilizada não gerava sons, era preciso decidir qual a fonte sonora que utilizaríamos. Visando dar mais naturalidade aos lentos movimentos produzidos pela performance, optamos por utilizar apenas sons vocais e derivados da respiração humana. Estaríamos assim, de certa forma, concedendo um caráter humano à vida que demos às luzes com a performance.

O performer produziria estes sons que seriam captados por um microfone sem fio, e o intérprete do sistema musical interativo também poderia gerar sons em tempo real em outro microfone, caso desejasse algum som específico para determinado momento.

Definimos utilizar nas apresentações: um performer para ficar em cena e lidar com as luzes, um intérprete para o sistema musical interativo responsável pelas questões sonoro-musicais e um intérprete para o sistema digital gerador das imagens responsável pela projeção na tela localizada no fundo do palco. Usamos também uma webcam, que permite ao performer, quando está fora da estrutura, registrar este momento do seu ponto de vista e, conseqüentemente, gerar novo material visual a ser enviado para a tela de projeção. Isto se converteu em uma terceira parte da apresentação, embasada em outra série de obras de Palatnik, “Progressões”, desenvolvidas continuamente desde a década de 60, e que tratam de um mesmo tema explorado repetidamente por ele em diversas obras: “dar ordem aos movimentos” (Osorio, 2004. p. 69).

Nesta série, Palatnik constrói obras visuais estáticas, originalmente feitas com madeira, formadas por uma seqüência de faixas verticais que dão uma forte sensação de movimento às imagens contidas nelas. É como se cada faixa simbolizasse a mesma imagem em movimento, em diferentes momentos temporais.

A estratégia utilizada para o uso da webcam neste momento consistia em utilizar imagens estáticas formadas por faixas verticais, onde as faixas intercalassem imagens captadas pela câmera em tempos distintos.

Levando em conta que os objetos captados neste momento eram as luzes LED com pisca-pisca, mesmo que a câmera ficasse parada, o resultado representaria o movimento da alternância das cores gerado pelo piscar das luzes.

A largura destas faixas e a velocidade com que as imagens estáticas eram atualizadas, eram constantemente alteradas em tempo real pelo intérprete do sistema digital gerador de imagens, seguindo padrões aleatórios. Tal manipulação foi programada no software Flash[1].

Na seguinte ilustração podemos observar algumas semelhanças entre as “Progressões” de Palatnik, com as imagens geradas em tempo real e projetadas no fundo do palco em “Sonocromática”.

[1] A programação em Flash foi feita por Andrei Thomaz.

Ilustração 64 – “Progressão 79-A”, 1965, Abraham Palatnik (Osorio, 2004. p. 124); e fragmento de “Sonocromática”, FILE RIO 2009 (Foto: Lílian Campesato).

Após o desenvolvimento desta terceira parte, as luzes LED iam se apagando até que restasse apenas uma que voltava para a estrutura e, depois de vagar por alguns instantes dentro desta, se apagava encerrando a performance.

Após os ensaios, definimos completamente a estrutura formal da obra, que segue resumidamente a seguinte ordem:

1 – Blackout. Aos poucos ouve-se sons de respiração e algumas lâmpadas são acessas, alternadamente, em pequena intensidade, dentro da estrutura localizada no centro do palco.

2 – Este jogo de luzes vai se desenvolvendo, e uma animação fazendo referência às imagens dentro da estrutura passa a ser projetada visando ampliar o campo visual do público. Sons vocais mais longos e contínuos são utilizados para marcar o lento e contínuo movimento, e, gradualmente, são substituídos por sons rítmicos, sempre acompanhando a intensidade das luzes e imagens.

3 – As luzes se apagam, restando apenas uma. Esta se transforma em uma luz oscilante (luz LED com pisca) que se movimenta pela estrutura até sair da mesma. As imagens se apagam, e o som de apenas uma voz solo acompanha esta luz.

4 – Fora da estrutura, a luz continua sua trajetória e, pouco a pouco, vai se multiplicando em diversas outras luzes que se movimentam no espaço, por alguns momentos, até serem colocadas sobre a estrutura. Não há nenhuma projeção. Diversas camadas de sons vão sendo acrescentadas e sons rítmicos são utilizados alternadamente aos sons longos.

5 – Com diversas luzes LED acesas sobre a estrutura, o performer utiliza uma webcam para registrar a movimentação feita por ele com estas luzes. As imagens captadas são manipuladas e projetadas em forma de faixas verticais. O som se torna mais rítmico e caótico.

6 – Aos poucos as luzes vão sendo apagadas, diminuído conseqüentemente a luminosidade da projeção. Os sons vão diminuindo de intensidade.

7 – A projeção é desligada. A última luz que resta piscando volta lentamente para dentro da estrutura, onde se movimenta brevemente. Os sons são reduzidos para uma única voz, derivada dos sons de respiração. A intensidade sonora vai diminuindo até o tacet, e a luz se apaga, finalizando a apresentação.

A forma que definimos para a performance era a de um arco contínuo de movimentos que se desenvolviam constantemente, partindo de e voltando para um repouso sonoro, visual e performático.

Por ser uma obra multimídia desenvolvida coletivamente, é natural que a composição da parte sonora e musical esteja atrelada ao desenvolvimento de todas as outras partes. A partitura que criei para os ensaios é, na verdade, um roteiro de intenções sonoras, visuais e performáticas, que individualmente não se sustentam enquanto obras completas, mas agregadas, produzem uma obra coletiva verdadeiramente multimídia, sem que nenhuma área seja dominante sobre as demais. O transcorrer temporal ocorre neste roteiro de cima para baixo, e cada coluna representa uma área de atuação: perfomance no palco; geração e projeção de imagens; e geração e manipulação sonora.

Ilustração 65 – Roteiro (partitura) utilizado em “Sonocromática”.

A coluna da direita indica níveis subjetivos da intensidade da performance como um todo, variando entre 0 e 10. Estes valores servem como um guia para que cada um dos participantes da apresentação possa planejar sua atuação no decorrer da performance.

O patch que desenvolvi para “Sonocromática” consiste essencialmente na repetição em loop de fragmentos sonoros armazenados em buffer. Em certos contextos, este processo pode produzir a sensação auditiva de um congelamento (freeze) temporal deste fragmento, similar, de certa forma, ao utilizado por Manoury em Jupiter[1].

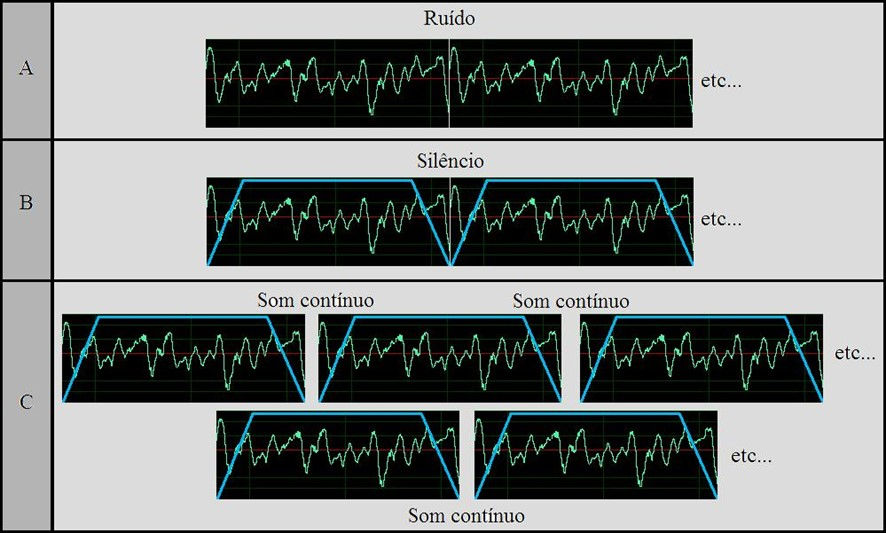

Para que este efeito funcione corretamente não adianta apenas colocar o fragmento em loop, pois, caso o final da onda sonora do fragmento seja diferente de seu início (o que quase sempre irá suceder), um ruído ocorrerá entre um loop e outro, interrompendo a continuidade do som e a sensação de congelamento do som.

Na próxima ilustração, podemos ver um exemplo visual deste caso no exemplo “A”. Para resolver esta questão, o que se costuma fazer é aplicar um envelope dinâmico no espectro sonoro do fragmento gravado, onde o início e o fim das ondas sonoras do fragmento fiquem com amplitude zero. Para isso, realiza-se normalmente um fade-in em seu início, e um fade-out no final. No exemplo “B”, temos os envelopes aplicados sobre o fragmento em loop e podemos ver as lacunas de amplitude que são obrigatoriamente criadas por este método, entre cada repetição. Para solucionar este momento de silêncio criado entre um loop e outro, costuma-se utilizar outra amostra deste fragmento, ou diversas outras amostras, que são sobrepostas à primeira camada do fragmento em loop, mas com um pequeno deslocamento temporal entre cada camada utilizada. Desta forma, enquanto uma estiver em silêncio, as outras estarão soando, preenchendo as possíveis lacunas e tornando o som perceptivelmente contínuo (Exemplo “C”).

[1] O freeze costuma ser criado a partir de fragmentos sonoros muito pequenos, medidos em algumas dezenas ou centenas de milissegundos. Por outro lado, o patch que desenvolvemos utiliza fragmentos maiores (geralmente entre 0.5 e 6 segundos). Mas como dissemos, conforme o fragmento sonoro utilizado, o efeito produzido é similar.

Ilustração 66 – Exemplos de loops realizados de formas distintas.

Este último exemplo é a base de funcionamento do patch criado para “Sonocromática”, mas, ao invés de realizar este processamento para gerar apenas um loop perceptivelmente contínuo, o patch pode criar até 5 loops independentes simultaneamente.

O tempo de gravação de cada fragmento de som possui uma duração diferente e variável, o que vai influenciar diretamente diversas características sonoras perceptíveis do loop. Até o momento estou utilizando principalmente as seguintes durações para cada fragmento: 0,5 segundo; 1 segundo; 2 segundos; 4 segundos; e 6 segundos. A ilustração seguinte (67) mostra um fragmento interno do patch de “Sonocromática”, responsável por um dos loops.

Para cada loop, é permitido ao usuário alterar, em tempo real, diversos parâmetros, como: ligar ou desligar; controlar o volume individual; fazer nova gravação de um fragmento sonoro; alterar o envelope aplicado em cada fragmento; mudar a velocidade de reprodução do fragmento (afetando simultaneamente as alturas e o andamento do mesmo); ligar e controlar a quantidade de aleatoriedade ao parâmetro “velocidade” que o programa gerará a cada repetição do loop; acionar ou não a reverberação em cada loop; e, por fim, acionar ou não o filtro presente em cada loop (filtro passa-banda, similar ao utilizado no patch da performance “Teia”), assim como controlar os seus parâmetros (freqüência central da banda, largura da banda e amplificação).

Para controlar simultaneamente estes parâmetros disponíveis na interface gráfica de “Sonocromática” para cada loop, tornou-se impraticável utilizar apenas o teclado e o mouse do computador. Optamos então por utilizar uma interface física, o controlador MIDI “PC1600x” da marca Peavey, que possui 16 sliders, 16 botões, e grande quantidade possível de configurações. Desta forma, o intérprete do sistema musical interativo praticamente não precisa tocar no computador durante a performance. Ele manipula a interface MIDI e observa as conseqüências na tela do computador, diretamente na interface do patch.

Ilustração 67 – Parte interna do patch de “Sonocromática” que controla um dos loops.

Apresento a seguir a interface final do patch criado em Max/MSP, para controlar os sons e a música de “Sonocromática”.

Ilustração 68 – Interface do patch de sonocromática.

Do lado esquerdo, em azul e verde, podemos ver a entrada e saída dos sinais de áudio; o controle do volume geral do som direto, que está sendo enviado para o gravador de cada loop; o volume que controla a quantidade geral de reverberação utilizada pelo patch; a entrada dos dados da interface MIDI da Peavey; e o crédito, o título e a data de criação do patch.

No centro, temos estas cinco fileiras entre as cores vermelho e laranja que representam os loops disponíveis. Cada fileira possui diversos botões e faders que podem controlar: a entrada do sinal dos microfones; a gravação de um novo fragmento sonoro; ligar ou desligar o loop; alterar a velocidade de reprodução do fragmento; ligar e controlar a porcentagem de aleatoriedade ao parâmetro “velocidade” a cada disparo de uma nova repetição; ligar ou desligar o filtro passa-banda; controlar o volume do loop com o filtro acionado; alterar parâmetros do filtros (freqüência central e largura da banda); controlar o volume do loop com o filtro desligado; e enviar ou não o som do loop para um processo de reverberação. E, à direita, em branco, temos os controles individuais de cada microfone, que podem ser enviados para os alto-falantes, passando pelo processo de reverberação ou não.

Como dissemos, os sons utilizados pelo patch são produzidos em tempo real pelo performer e pelo intérprete do sistema musical interativo, e são captados através de microfones. Todos processamentos também ocorrem todos em tempo real e são controlados por este mesmo intérprete.

Os sons são criados de forma livre, mas dentro de uma estrutura bastante definida. Deste modo, existe uma linha muito tênue entre a composição e o improviso. Mesmo que a estrutura formal indique um caminho para o intérprete seguir, ela não restringe em nenhum momento detalhes de como os sons devem ser produzidos. São as decisões do performer e do intérprete do sistema interativo, no momento da performance da obra, que irão definir os verdadeiros sons utilizados e manipulados pelo patch.

A performance, neste caso é, novamente, o mais importante elemento composicional, e todo o trabalho de composição consiste basicamente em criar uma estrutura que dê liberdade à performance, ao mesmo tempo em que permite e conduz o desenvolvimento da mesma.

O desenvolvimento coletivo de “Sonocromática” faz com que os estímulos composicionais sejam gerados por todos os integrantes do grupo. Os conceitos para cada área são discutidos por todos e depois cada membro desenvolve sua atuação de acordo com sua especialidade. Como todo este processo envolve muita reflexão e diálogo, é muito difícil dizer quando o trabalho está finalizado, e após cada apresentação, nos reunimos para ver como aprimorar a obra. A performance “Teia”, por exemplo, que é mais antiga e foi apresentada mais vezes, foi considerada por nós como uma obra conceitual e formalmente completa apenas recentemente. “Sonocromática”, que foi apresentada apenas três vezes em duas oportunidades distintas, apesar de já ter uma estrutura conceitual e formal muito bem definida, ainda é uma peça que vem sendo ajustada, em seus detalhes, a cada apresentação. Assim como “Teia”, “Sonocromática” deve ser adaptada para cada palco, alterando os recursos de iluminação, o posicionamento dos intérpretes dos sistemas digitais (que devem estar fora de cena), o sistema de som e assim por diante.

A performance estreou no FILE2008 Hipersônica (Festival Internacional de Linguagem Eletrônica), no teatro SESI, em São Paulo, agosto de 2008; e depois também foi apresentada no FILE RIO 2009 (duas apresentações), teatro do Oi Futuro, Rio de Janeiro, março de 2009. As apresentações foram feitas por: Francisco Serpa, performer; Andrei Thomaz, intérprete do sistema digital gerador de imagens; Vitor Kisil, intérprete do sistema musical interativo; Lílian Campesato, assistente de palco; e Fernando Iazzetta (FILE RIO), assistente e controlador técnico.

Detalhamento do sistema utilizado em “Sonocromática”:

Grupo Ao Cubo – Sonocromática – 2008-2009:

Intérpretes: 3. 1 performer e controlador das luzes; 1 intérprete para sistema musical interativo; e 1 intérprete para sistema digital de imagens.

Duração: Aproximadamente 15 minutos.

Funcionamento do sistema musical interativo:

Entrada dos dados: Através de dois microfones, um sem fio, utilizado pelo performer, e outro utilizado pelo intérprete do sistema interativo. Também é utilizada, em um determinado momento, uma webcam para gerar as imagens projetadas na tela no fundo do palco.

Processamentos: Áudio – gravação de até cinco loops independentes, que podem ser sobrepostos e alterados em alguns parâmetros, como velocidade (alterando duração e freqüências), uso de reverberação e filtragem. O respectivo patch foi desenvolvido no programa Max/MSP, e é controlado em tempo real pelo intérprete do sistema interativo. Imagens – disparo do processamento pré-programado de um animação em Flash, seguido da manipulação das imagens captadas pela webcam, também em Flash, para a geração de novas imagens.

Resposta do sistema: Através de alto-falantes e de um projetor de vídeo.